1. Linear Regreeion

X : 독립변수, Y: 종속변수

장점 : 사용 쉬움, 설명 쉬움

단점 : 선형회귀만 설명가능, 관련없는 데이터도 결과에 영향줌

1차원인 경우는 line으로 표현

다차원인 경우

b0 : y절편, bi : X가 변할 때 Y에 영향을 주는 값

regression의 목표!

모델이 위와 같이 추정할 때 최적의 bi헷을 구하는 것

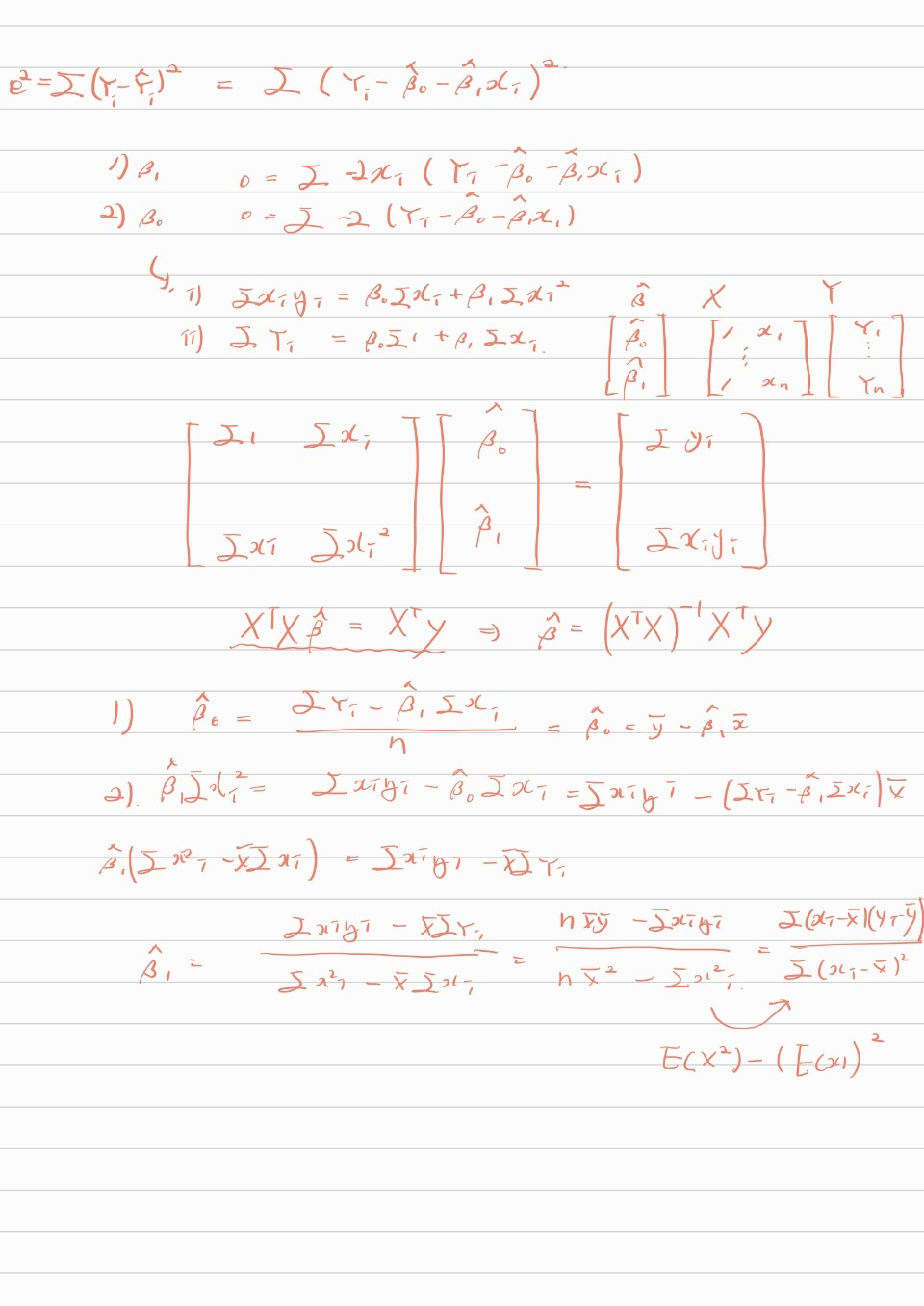

최적의 베타는 어떻게 구할까?

- least squars method ( 오차 제곱 최소화 )

모델 평가

y와 y헷의 차이를 기반으로 mse, rmse, mae, mape를 구함

performance measurements

R^2 결정계수 = SSR/SST = 1 - SSE/SSR => 1에 가까울 수록 모델이 좋음

SSE = SST + SSR

SST, SSE, SSR

하지만,

결정계수 R^2은 종속변수가 늘어나면 증가하는 경향이 있음

따라서, 종속변수에 따라 값을 adjust해줄 필요가 있음

또한, 모델 성능에 제한을 두어 과적합을 막아야한다.

Regularization

l1-norm, l2-norm

non-linear regression

선형모델로 비선형 데이터 학습x

다항 데이터 학습 => 다차원 함수생성

'머신러닝' 카테고리의 다른 글

| 6장 Model Evaluation (1) | 2023.10.25 |

|---|---|

| 5장 Nearest Neighbor Method (0) | 2023.10.25 |

| 4장 Logistic Legression (0) | 2023.10.25 |

| 2장 Bayesian Classifier (1) | 2023.10.23 |

| 1장 Introdution to Machine Learning (0) | 2023.10.23 |