페셉트론 = 인공뉴런

=> 다수의 입력에 weighted sum + bias의 값을 activation function에 입력하여 output을 얻는다.

하지만 그냥 퍼셉트론은 non-linear 해결 x -> MLP ( multilayer perceptron )등장

- universal approximation theory

어떤 non-linear문제도 퍼셉트론 여러개로 가능

feedforward vs backpropagation

히든 노드 or layer 많을 수록 capacity 향상

히든 레이어 af의 역할 : nonliner transformation

분류인 경우 output 레이어의 af의 역할 : 원핫인코딩처럼 확률 나눠서 내줌 or softmax(각 결과 확률로)

회귀인 경우 문제에 따라

t = 실제값, z= output

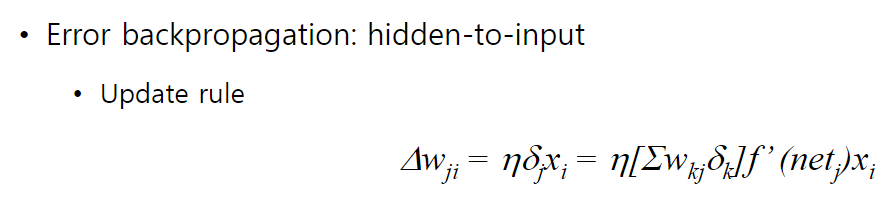

Back

앞에서 구한 loss를 줄이기 위해 w와 bias를 업데이트하는 과정

'머신러닝' 카테고리의 다른 글

| 12. Dimensionality Reduction (0) | 2023.12.18 |

|---|---|

| 11. Kerner Method (0) | 2023.12.18 |

| 7. Decision Tree (0) | 2023.12.17 |

| 6장 Model Evaluation (1) | 2023.10.25 |

| 5장 Nearest Neighbor Method (0) | 2023.10.25 |